Unternehmen stehen vor der Herausforderung, Produkte und Prozesse nachhaltig zu gestalten und Emissionen über den gesamten Lebenszyklus zu reduzieren. Der Product Carbon Footprint (PCF) erfasst alle Treibhausgasemissionen, die über den Lebenszyklus eines Produktes entstehen. Während interne Emissionsdaten oft verfügbar sind, müssen Unternehmen zur Bestimmung des PCF Daten über die gesamte Lieferkette eines Produktes nachverfolgen und zusammenführen. Diese Informationen individuell bei allen Zulieferern anzufragen und zu sammeln, ist kaum machbar. Hier setzen souveräne Datenökosysteme wie Catena-X und Manufacturing-X an. Mit ihnen lassen sich Daten einfacher und kontrollierter über Unternehmensgrenzen hinweg austauschen.

Externe Daten bei der PCF-Berechnung

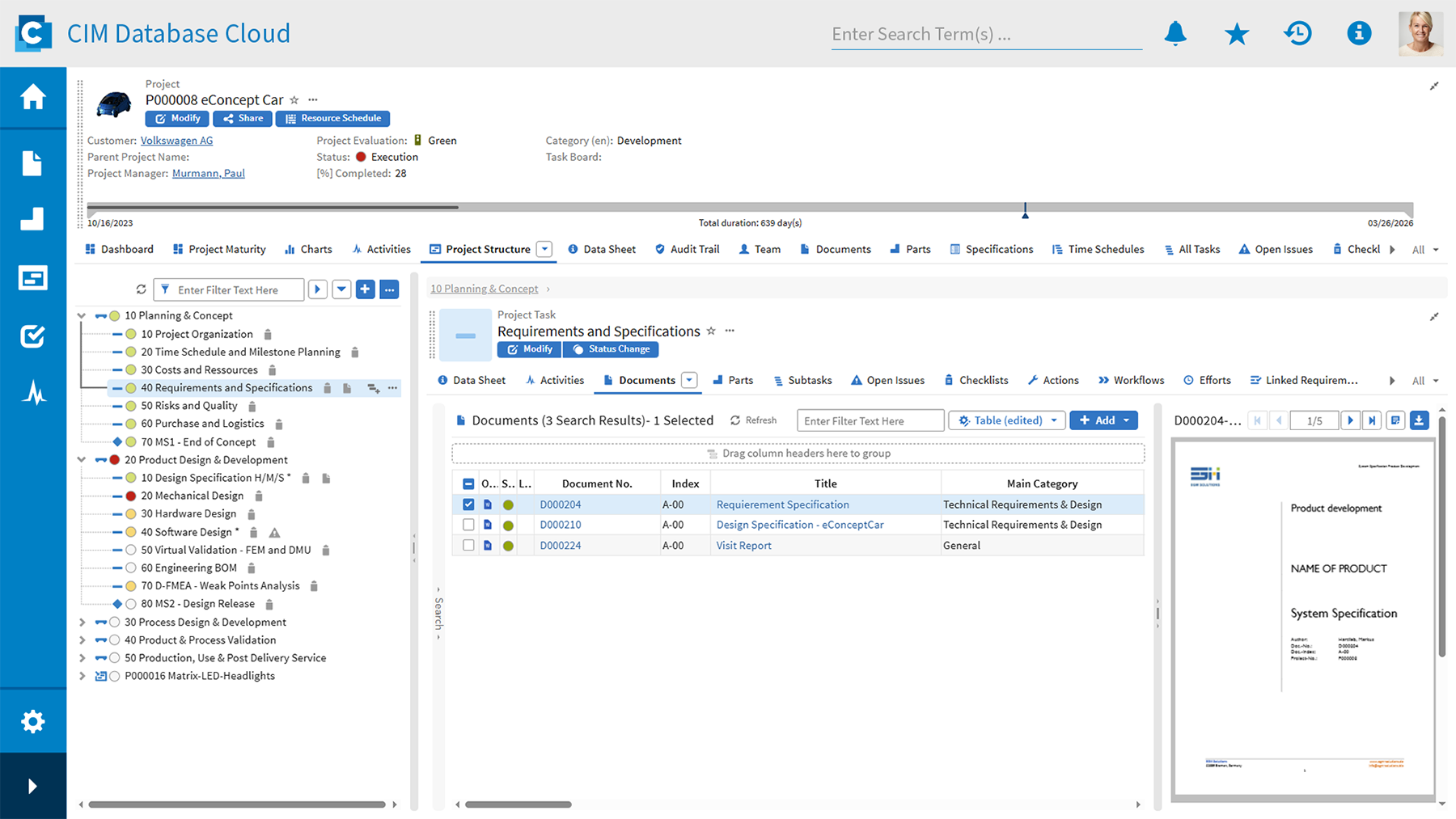

Product Lifecycle Management (PLM)-Systeme verwalten bereits viele Daten, die zur Bestimmung eines PCF dienen. Sie enthalten Informationen zu Produkten, Varianten und Stücklisten. Viele Emissionen fallen aber bereits in der vorgelagerten Wertschöpfungskette, wie der Rohstoffgewinnung oder durch Produktions- und Transportprozesse an. Diese Daten anzufragen und zu pflegen, ist aufwendig und geschieht heute durch dokumentenbasierte Vorlagen, Excel-Tabellen oder spezielle Web-Portale. Das Teilen von Daten erfolgt auf Zuruf.

Für die Zulieferer skaliert das Konzept mit kundenindividuellen Portalen und Templates nicht. Die angefragten Datenfelder sind nicht standardisiert, eingegebene Daten, Formate und verwendete Berechnungsmethoden passen nicht zusammen. Dadurch entsteht ein enormer Aufwand auf allen Seiten: Daten werden händisch zusammengestellt, eingetragen und geprüft, was das Risiko für Übertragungsfehler mit sich bringt.

Datenökosysteme als Alternative

Datenökosysteme wie Gaia-X und Catena-X wirken diesen Datensilos entgegen und vereinfachen das Teilen über die gesamte Lieferkette. Anstatt die benötigten Daten individuell anzufordern und für jeden Kunden auf verschiedene Plattformen hochzuladen, stellen Unternehmen sie in standardisierten Datenformaten bereit. Benötigt ein Teilnehmer im Ökosystem diese Daten, greift er einfach durch festgelegte Protokolle darauf zu. Die Kontrolle bleibt dabei beim Bereitsteller der Daten. Jeder Teilnehmer entscheidet selbst, welche Daten er zu Verfügung stellt, mit wem er diese teilt und wofür sie verwendet werden dürfen.

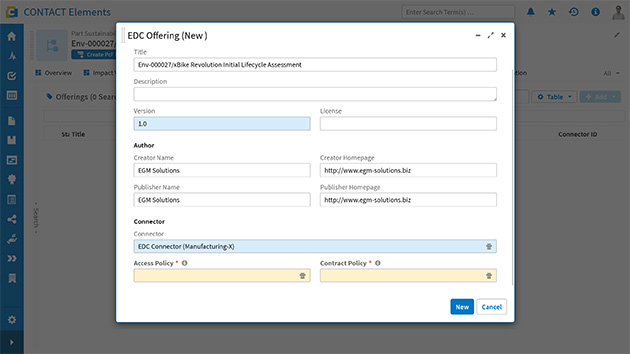

Grundlage ist ein Connector basierend auf den Eclipse Dataspace Components (EDC). Jeder Teilnehmer steuert über seinen EDC die Daten und Bedingungen, mit denen er am Ökosystem teilnehmen möchte. Der Connector stellt diese in einem durchsuchbaren Katalog zusammen. Möchte ein anderes Unternehmen auf die Daten zugreifen, handeln die beiden EDCs vollautomatisch die Konditionen aus, die für den Datenaustausch gelten. Erst mit einem so geschlossenen, rechtsverbindlichen Vertrag erhält der andere Teilnehmer Zugriff auf die Daten. So behält jeder Beteiligte die volle Kontrolle über seine Daten.

PCF-Berechnung in Datenökosystemen

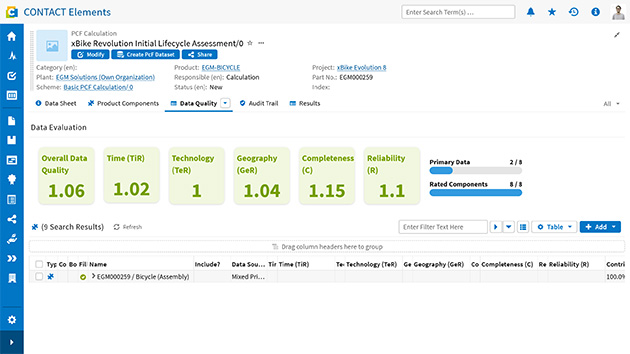

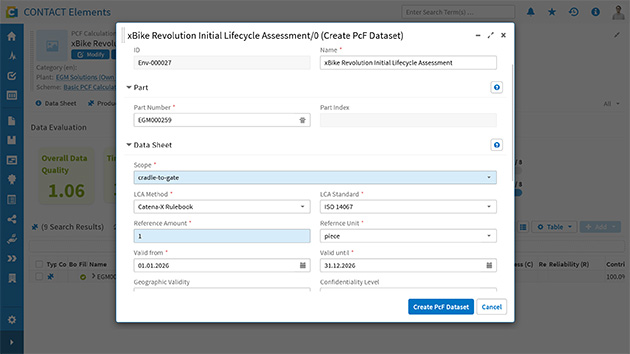

PLM-Systeme sind der ideale Ausgangspunkt für PCF-Berechnungen. Stücklisten und Arbeitspläne bilden die Grundlage, um interne Emissionen zu erfassen. Über Datenökosysteme können Unternehmen nun auch Daten von externen Partnern und Zulieferern in die Berechnung integrieren. Für Zukaufteile werden nicht nur Lieferanten, sondern auch deren digitale Identität im Datenraum verwaltet. Das ermöglicht es, die PCF-Werte für externe Artikel direkt am EDC des Zulieferers zu suchen und zu importieren.

Ist die PCF-Berechnung für ein Produkt abgeschlossen, kann das Ergebnis zur weiteren Verwendung entlang der Wertschöpfungskette im Datenökosystem bereitgestellt werden. So bestimmt jedes Unternehmen individuell, mit wem und unter welchen Bedingungen es die Daten teilt. Der Datensatz zum Angebot steht im eigenen EDC-Katalog, ganz ohne Excel-Tabellen und Webportale.

Warum PLM-Systeme der natürliche Integrationspunkt sind

Dieser gesamte Workflow muss dort stattfinden, wo Produktdaten bereits verwaltet werden: PLM-Systeme managen Stücklisten, Lieferantenbeziehungen und Engineering-Workflows. Sie sind die Single-Source-of-Truth für Produktinformationen über den Lebenszyklus.

Die Teilnahme an Datenökosystemen erfordert PLM-Systeme mit offenen Standardschnittstellen. Nur so lassen sich die Potenziale von Datenökosystemen voll ausschöpfen. Die Workflows für Engineering-Prozesse regeln nun auch, wie interne und externe PCF-Daten integriert werden. Die Lieferantendatenbank enthält jetzt auch Identitäten im Datenraum und Audit-Trails erfassen neben internen Änderungen auch externe Datenaustausche.

Wertschöpfung entsteht heute zu großen Teilen aus der Fähigkeit, Produktdaten schnell und verlässlich über die Lieferkette auszutauschen. Nur eine tiefe Integration zwischen internen PLM-Systemen und externen Datenökosysteme schaffen die nötige Effizienz und Vertrauen: nach innen und nach außen.