Optimierte Prozesse, Sicherheit und globale Zusammenarbeit im Produktlebenszyklus

Wie können Unternehmen ihre Daten und Dokumente effizient verwalten? Wie stellen sie Informationen abteilungs-, standort- und organisationsübergreifend zur Verfügung?

Schon in einzelnen Projekten wächst die Zahl der Dokumente schnell in die Hunderte oder Tausende. Diese Daten auf Netzlaufwerken oder in E-Mail-Systemen zu verwalten, führt angesichts der Komplexität der Produktentwicklung in eine Sackgasse. Unternehmen benötigen stattdessen eine Dokumentenlogistik, die Übersicht schafft und Teamwork fördert.

Für diese Aufgabe eignet sich Software für Product Lifecycle Management (PLM). Gerade Cloud-basierte Systemegestalten das Dokumentenmanagement durch die Integration aller Abläufe und Informationen über den gesamten Produktlebenszyklus effizienter. In diesem Blogbeitrag werfen wir einen Blick darauf, wie Cloud PLM-Systeme das Dokumentenmanagement erleichtern.

Welche Vorteile hat die cloudbasierte Speicherung von Dokumenten?

Dokumentenmanagement über die Cloud durchzuführen, hat zwei wesentliche Vorteile. Zum einen fördern Unternehmen globale Zusammenarbeit in Echtzeit. Teams können weltweit auf geltungssichere Dokumente zugreifen und gemeinsam daran arbeiten. Entwicklungszeiten verkürzen sich dadurch erheblich.

Zum anderen sind Unternehmen nicht selbst für die Sicherheit ihres Systems verantwortlich. Die Cloud-Anbieter müssen strenge Zertifizierungen und Audits durchführen und genügen daher höchsten Sicherheitsstandards. Sensible Informationen sind durch Datenverschlüsselung, Zugriffskontrollen und regelmäßige Sicherheits-Updates optimal geschützt. Das erleichtert Kunden unter anderem die Einhaltung von Compliance-Vorgaben wie ISO und GDPR.

Was sind die Vorteile der Dokumentenmanagement-Funktion in PLM-Systemen?

1. Zentrale Datenablage

Mit der Dokumentenmanagement-Funktion lassen sich Dokumente unternehmensweit organisieren. Dies fördert die Zusammenarbeit und den Wissensaustausch innerhalb der Teams. Produktrelevante Dokumente, zum Beispiel CAD-Dateien, werden an einem zentralen Ort verwaltet. Dies vermeidet Datenredundanzen und stellt sicher, dass alle Abteilungen auf aktuelle Informationen zugreifen.

2. Versionskontrolle und Änderungsverfolgung

PLM-Systeme erlauben die Versionierung von Dokumenten. Da jede Änderung protokolliert wird, arbeiten Teams immer mit den neuesten Daten.

3. Workflow- und Freigabeprozesse

Integrierte Workflows ermöglichen es, Genehmigungsprozesse und die Freigabe von Dokumenten zu automatisieren. Dies beschleunigt Entscheidungsprozesse und sorgt auch ohne manuelle Eingriffe für strukturierte Abläufe.

4. Zugriffskontrollen

In einem PLM-System können Zugriffsrechte klar definiert und gesteuert werden. Dadurch greifen ausschließlich berechtigte Personen auf sensible Dokumente zu.

5. Erfüllung von Compliance-Vorgaben

PLM-Systeme bieten eine revisionssichere Ablage, um regulatorische Anforderungen und branchenspezifische Normen (z. B. ISO) einzuhalten.

6. Integrierte Daten und Prozesse

Dokumentenmanagement ist oft eng mit Bereichen wie Projektmanagement, Qualitätskontrolle oder Produktentwicklung verknüpft. PLM-Systeme integrieren alle produktbezogenen Prozesse und gewährleisten eine ganzheitliche Verwaltung.

7. Kosteneinsparungen und Effizienzsteigerung

Mit der Dokumentenmanagement-Funktion nutzen Mitarbeitende ihre Arbeitszeit effektiver. Sie sparen Zeit bei der Suche nach Dokumenten und vermeiden Fehler durch veraltete Informationen. Die bessere Zusammenarbeit zwischen Teams senkt langfristig Kosten. Automatisierte Prozesse sorgen für schnellere Durchlaufzeiten.

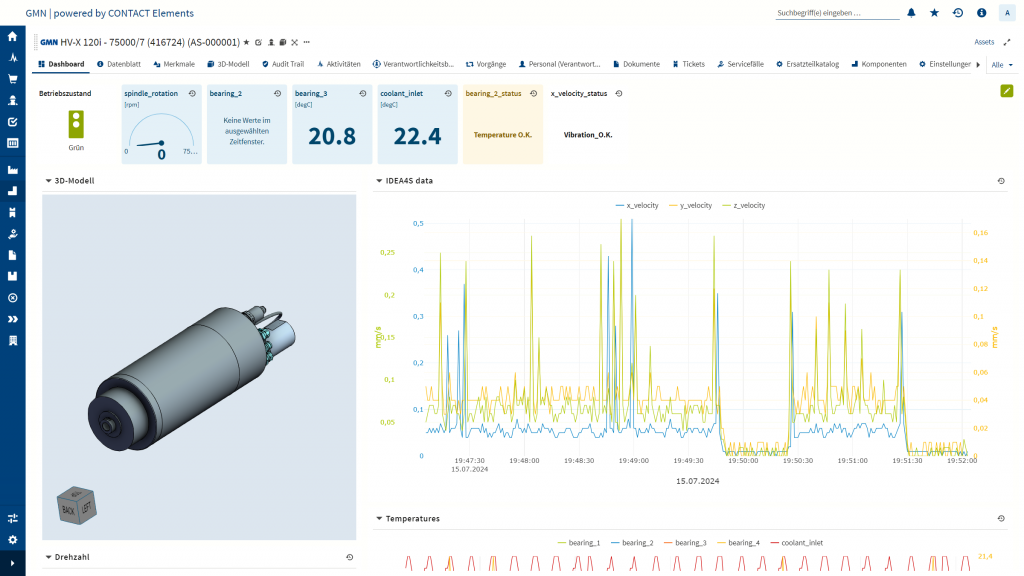

Was zeichnet Dokumentenmanagement mit CIM Database Cloud aus?

Die intelligente Dokumentenlogistik von CIM Database Cloud ermöglicht es, auch in komplexen Prozessen die Übersicht zu behalten und die Zusammenarbeit zu verbessern. Eine leistungsfähige Volltextsuche beschleunigt die Suche nach Dokumenten und erleichtert den Zugriff auf wichtige Informationen.

Dank der nahtlosen Integration mit Microsoft Office for the web™ können Mitarbeitende ihre Anwendungen wie gewohnt nutzen und Dokumente erstellen, bearbeiten und austauschen (ohne separate Speicherung). Die Dateien werden im Cloud-PLM-Dateispeicher verwaltet. Daher arbeiten bei Bedarf mehrere Personen gleichzeitig am selben Dokument – ohne lokale MS-Office-Installationen.

Fazit

Cloud PLM-Systeme können eine leistungsstarke, sichere Lösung für das Dokumentenmanagement bieten. Funktionen wie Versionierung und Workflow-Automatisierung sowie strikte Sicherheitsmaßnahmen helfen, Dokumente effizient zu verwalten. Unternehmen minimieren Risiken und gewährleisten die Einhaltung von Compliance-Vorgaben. Gleichzeitig sorgt die cloudbasierte Struktur für maximale Flexibilität: Teams arbeiten jederzeit und von überall aus zusammen.

Erfahren Sie mehr darüber, wie CONTACT CIM Database Cloud Ihr Dokumentenmanagement optimieren kann.